гЂЬиЖћПЊдД NPU МгЫйПтЃЌЗНБуЪЙПЊЗЂШЫдБгХЛЏЦф AI гІгУ

ЗЂВМЪБМфЃК2024-3-3 11:03

ЗЂВМепЃКeechina

|

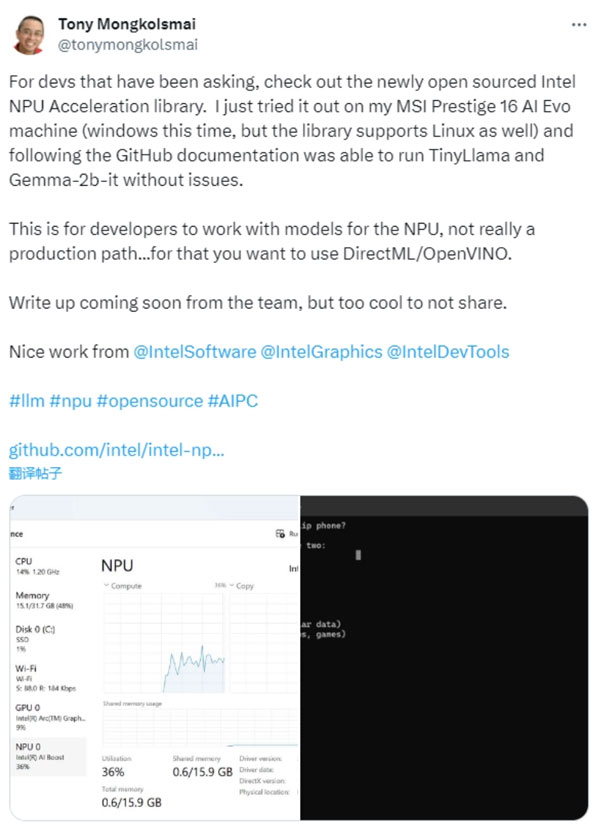

РДдДЃКITжЎМв @Tony Mongkolsmai ЗЂЯжЃЌгЂЬиЖћвбОдк GitHub ЩЯПЊдДСЫЦф NPU МгЫйПтЃЌжЇГж Windows КЭ LinuxЁЃ ПЊЗЂШЫдБПЩвдАДееЯргІЮФЕЕЖдЦфШэМўНјаагХЛЏЃЌДгЖјЪЪХфаТвЛДњ AI ФЃаЭЃЌАќРЈ TinyLlama КЭ Gemma-2b-itЁЃ

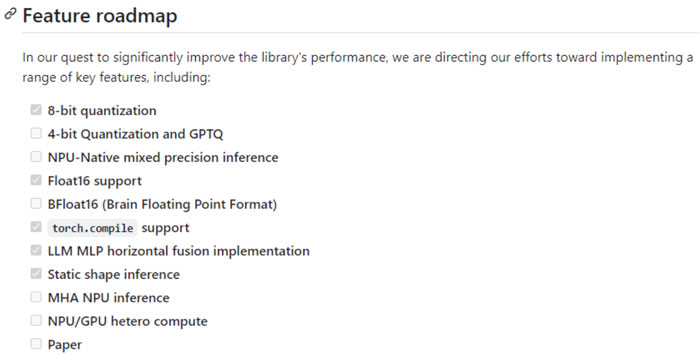

ИљОнЙйЗНУшЪіЃКгЂЬиЖћ NPU МгЫйПтЪЧвЛИі Python ПтЃЌжМдкРћгУгЂЬиЖћЩёОДІРэЕЅдЊ (NPU) ЕФЧПДѓадФмдкМцШнгВМўЩЯжДааИпЫйМЦЫуЃЌДгЖјЬсИпгІгУЕФаЇТЪЁЃ гЂЬиЖћЛЙБэЪОЦф NPU МгЫйПтФПЧАВЛЖЯПЊЗЂжаЃЌКѓајНЋЭЦГіИїжжФмЯджјЬсИпадФмЕФЙІФмЃЌНижСITжЎМвЗЂИхвбОЪЕЯжСЫ 8bit СПЛЏЁЂFloat16 жЇГжЁЂtorch.compile жЇГжЕШЃЌКѓајЛЙНЋжЇГж NPU / GPU вьЙЙМЦЫуЕШЙІФмЁЃ

|

ЭјгбЦРТл